MPEG4 ist eine zur Überwachung geeignete Komprimierungstechnologie

MPEG4 wurde im November 1998 angekündigt. Der internationale Standard MPEG4, der ursprünglich im Januar 1999 in Betrieb genommen werden sollte, gilt nicht nur für die Video- und Audiocodierung mit einer bestimmten Bitrate, sondern widmet auch der Interaktivität und Flexibilität von MPEG4 mehr Aufmerksamkeit Multimedia-Systeme. Die Experten der MPEG-Expertengruppe arbeiten hart an der Formulierung von MPEG-4. Der MPEG-4800-Standard wird hauptsächlich in Videotelefonen, Video-E-Mails und elektronischen Nachrichten usw. verwendet. Die Anforderungen an die Übertragungsrate sind relativ niedrig und liegen zwischen 64000 und 4800 Bit / s, und die Auflösung liegt zwischen 64000 und 176 Bit / s. Es ist 144X4. MPEG-XNUMX verwendet eine sehr schmale Bandbreite, komprimiert und überträgt Daten mithilfe der Frame-Rekonstruktionstechnologie, um die geringsten Daten und die beste Bildqualität zu erhalten.

Im Vergleich zu MPEG-1 und MPEG-2 zeichnet sich MPEG-4 dadurch aus, dass es sich besser für interaktive AV-Dienste und Fernüberwachung eignet. MPEG-4 ist der erste dynamische Bildstandard, der Sie von passiv zu aktiv wechselt (nicht mehr nur zuschauen, sondern auch interaktiv mitmachen können). ein weiteres Merkmal davon ist seine Vollständigkeit; Von der Quelle aus versucht MPEG-4, natürliche Objekte mit künstlichen Objekten zu mischen (im Sinne von visuellen Effekten). Das Designziel von MPEG-4 hat auch eine größere Anpassungsfähigkeit und Skalierbarkeit. MPEG4 versucht zwei Ziele zu erreichen:

1. Multimedia-Kommunikation mit niedriger Bitrate;

2. Es ist die Synthese von Multimedia-Kommunikation in mehreren Branchen.

Entsprechend diesem Ziel führt MPEG4 AV-Objekte (Audio / Visaul-Objekte) ein, die interaktivere Operationen ermöglichen. Die Videoqualitätsauflösung von MPEG-4 ist relativ hoch und die Datenrate relativ niedrig. Der Hauptgrund ist, dass MPEG-4 die ACE-Technologie (Advanced Decoding Efficiency) verwendet, eine Reihe von Regeln für Codierungsalgorithmen, die erstmals in MPEG-4 verwendet werden. Eine auf ACE bezogene Zielorientierung kann sehr niedrige Datenraten ermöglichen. Im Vergleich zu MPEG-2 können 90% des Speicherplatzes eingespart werden. MPEG-4 kann auch in Audio- und Videostreams umfassend aktualisiert werden. Wenn sich das Video zwischen 5 kb / s und 10 Mb / s ändert, kann das Audiosignal zwischen 2 kb / s und 24 kb / s verarbeitet werden. Es ist besonders wichtig zu betonen, dass der MPEG-4-Standard eine objektorientierte Komprimierungsmethode ist. Es wird nicht einfach das Bild in einige Blöcke wie MPEG-1 und MPEG-2 unterteilt, sondern je nach Bildinhalt die Objekte (Objekte, Zeichen, Hintergrund). Es wird getrennt, um eine Intra-Frame- und Inter-Frame-Codierung durchzuführen und Komprimierung und ermöglicht die flexible Zuordnung von Coderaten zwischen verschiedenen Objekten. Wichtigen Objekten werden mehr Bytes zugewiesen, und sekundären Objekten werden weniger Bytes zugewiesen. Somit wird das Komprimierungsverhältnis stark verbessert, so dass bessere Ergebnisse bei einer niedrigeren Coderate erzielt werden können. Durch die objektorientierte Komprimierungsmethode von MPEG-4 werden auch die Bilderkennungsfunktion und die Genauigkeit besser reflektiert. Die Bilderkennungsfunktion ermöglicht dem Festplatten-Videorecordersystem eine bessere Video-Bewegungsalarmfunktion.

Kurz gesagt, MPEG-4 ist ein brandneuer Videocodierungsstandard mit niedriger Bitrate und hohem Komprimierungsverhältnis. Die Übertragungsrate beträgt 4.8 bis 64 kbit / s und nimmt einen relativ kleinen Speicherplatz ein. Beispiel: Für einen Farbbildschirm mit einer Auflösung von 352 × 288 sind bei Auswahl von 1.3 KB pro Sekunde bei einem Bild von 25 KB pro Stunde 120 KB pro Stunde, 10 Stunden pro Tag und 30 Tage pro Monat erforderlich und 36 GB pro Kanal und Monat. Wenn es sich um 8 Kanäle handelt, sind 288 GB erforderlich, was offensichtlich akzeptabel ist.

In diesem Bereich gibt es viele Arten von Technologien, aber die grundlegendsten und am weitesten verbreiteten gleichzeitig sind MPEG1, MPEG2, MPEG4 und andere Technologien. MPEG1 ist eine Technologie mit einem hohen Komprimierungsverhältnis, aber einer schlechteren Bildqualität. Während sich die MPEG2-Technologie hauptsächlich auf die Bildqualität konzentriert und das Komprimierungsverhältnis gering ist, ist ein großer Speicherplatz erforderlich. Die MPEG4-Technologie ist heutzutage eine populärere Technologie. Diese Technologie kann Platz sparen, hat eine hohe Bildqualität und erfordert keine hohe Netzwerkübertragungsbandbreite. Im Gegensatz dazu ist die MPEG4-Technologie in China relativ beliebt und wurde auch von Branchenexperten anerkannt.

Da der MPEG4-Standard Telefonleitungen als Übertragungsmedium verwendet, können Decoder gemäß der Einführung vor Ort gemäß den unterschiedlichen Anforderungen der Anwendung konfiguriert werden. Der Unterschied zu der auf dedizierter Hardware basierenden Komprimierungscodierungsmethode besteht darin, dass das Codierungssystem offen ist und jederzeit neue und effektive Algorithmusmodule hinzugefügt werden können. MPEG4 passt die Komprimierungsmethode an die räumlichen und zeitlichen Eigenschaften des Bildes an, um ein größeres Komprimierungsverhältnis, einen geringeren Komprimierungscode-Stream und eine bessere Bildqualität als MPEG1 zu erzielen. Die Anwendungsziele sind Schmalbandübertragung, hochwertige Komprimierung, interaktive Operationen und Ausdrücke, die natürliche Objekte mit künstlichen Objekten integrieren und gleichzeitig eine breite Anpassungsfähigkeit und Skalierbarkeit hervorheben. Daher basiert MPEG4 auf den Merkmalen der Szenenbeschreibung und des bandbreitenorientierten Designs, was es für den Bereich der Videoüberwachung sehr geeignet macht, was sich hauptsächlich in den folgenden Aspekten widerspiegelt:

1. Speicherplatz wird gespart - der für die Verwendung von MPEG4 erforderliche Speicherplatz beträgt 1/10 des von MPEG1 oder M-JPEG. Da MPEG4 die Komprimierungsmethode automatisch an Szenenänderungen anpassen kann, kann außerdem sichergestellt werden, dass die Bildqualität bei Standbildern, allgemeinen Sportszenen und Szenen mit intensiven Aktivitäten nicht beeinträchtigt wird. Es ist eine effektivere Videokodierungsmethode.

2. Hohe Bildqualität - Die höchste Bildauflösung von MPEG4 beträgt 720 x 576, was dem Bildeffekt von DVD nahe kommt. MPEG4 basierend auf dem AV-Komprimierungsmodus stellt fest, dass es eine gute Definition für sich bewegende Objekte gewährleisten kann, und die Zeit / Zeit / Bildqualität ist einstellbar.

3. Die Anforderung an die Netzwerkübertragungsbandbreite ist nicht hoch - da das Komprimierungsverhältnis von MPEG4 mehr als das Zehnfache des von MPEG10 und M-JPEG gleicher Qualität beträgt, beträgt die während der Netzwerkübertragung belegte Bandbreite nur etwa 1/1 davon von MPEG10 und M-JPEG der gleichen Qualität. . Unter den gleichen Anforderungen an die Bildqualität benötigt MPEG1 nur eine geringere Bandbreite.

====================

Technische Highlights des neuen Videocodierungsstandards H.264

Zusammenfassung:

Für praktische Anwendungen ist die H.264-Empfehlung, die von den beiden großen internationalen Normungsorganisationen ISO / IEC und ITU-T gemeinsam formuliert wurde, eine Neuentwicklung in der Videokodierungstechnologie. Es verfügt über einzigartige Funktionen in der Multimode-Bewegungsschätzung, der Ganzzahltransformation, der einheitlichen VLC-Symbolcodierung und der geschichteten Codierungssyntax. Daher weist der H.264-Algorithmus eine hohe Codierungseffizienz auf, und seine Anwendungsaussichten sollten offensichtlich sein.

Schlüsselwörter: Videokodierung Bildkommunikation JVT

Seit den 1980er Jahren leitete die Einführung von zwei großen Serien internationaler Videokodierungsstandards, MPEG-x nach ISO / IEC und H.26x nach ITU-T, eine neue Ära der Videokommunikations- und Speicheranwendungen ein. Von H.261-Videocodierungsempfehlungen bis hin zu H.262 / 3, MPEG-1/2/4 usw. gibt es ein gemeinsames Ziel, das ständig verfolgt wird, nämlich so viel wie möglich unter der niedrigstmöglichen Bitrate zu erhalten (oder Speicherkapazität). Gute Bildqualität. Darüber hinaus wird mit zunehmender Nachfrage des Marktes nach Bildübertragung das Problem der Anpassung an die Übertragungseigenschaften verschiedener Kanäle immer offensichtlicher. Dies ist das Problem, das durch den neuen Videostandard H.264 gelöst werden muss, der gemeinsam von IEO / IEC und ITU-T entwickelt wurde.

H.261 ist der früheste Vorschlag für die Videokodierung. Der Zweck besteht darin, die Videokodierungstechnologie in Fernseh- und Videotelefonanwendungen für ISDN-Netzwerkkonferenzen zu standardisieren. Der verwendete Algorithmus kombiniert eine hybride Codierungsmethode zur Vorhersage zwischen Rahmen, die die zeitliche Redundanz verringern kann, und eine DCT-Transformation, die die räumliche Redundanz verringern kann. Es entspricht dem ISDN-Kanal und seine Ausgabecoderate beträgt p × 64 kbit / s. Wenn der Wert von p klein ist, können nur Bilder mit niedriger Auflösung übertragen werden, was für persönliche Fernsehanrufe geeignet ist. Wenn der Wert von p groß ist (z. B. p> 6), können Konferenz-TV-Bilder mit besserer Definition übertragen werden. H.263 empfiehlt einen Bildkomprimierungsstandard mit niedriger Bitrate, der technisch eine Verbesserung und Erweiterung von H.261 darstellt und Anwendungen mit einer Bitrate von weniger als 64 kbit / s unterstützt. Tatsächlich wurden jedoch H.263 und höher H.263 + und H.263 ++ entwickelt, um Anwendungen mit voller Bitrate zu unterstützen. Es ist aus der Tatsache ersichtlich, dass es viele Bildformate unterstützt, wie Sub-QCIF, QCIF, CIF, 4CIF und sogar 16CIF und andere Formate.

Die Coderate des MPEG-1-Standards beträgt etwa 1.2 Mbit / s und kann 30 Bilder von Bildern in CIF-Qualität (352 × 288) liefern. Es wurde für die Videospeicherung und Wiedergabe von CD-ROMs entwickelt. Der grundlegende Algorithmus des MPEG-261-Standardvideocodierungsteils ähnelt H.263 / H.1, und es werden auch Maßnahmen wie bewegungskompensierte Interframe-Vorhersage, zweidimensionale DCT- und VLC-Lauflängencodierung angewendet. Zusätzlich werden Konzepte wie Intra-Frame (I), Predictive Frame (P), bidirektionaler Predictive Frame (B) und DC-Frame (D) eingeführt, um die Codierungseffizienz weiter zu verbessern. Auf der Grundlage von MPEG-2 hat der MPEG-4-Standard einige Verbesserungen bei der Verbesserung der Bildauflösung und der Kompatibilität mit digitalem Fernsehen vorgenommen. Zum Beispiel beträgt die Genauigkeit seines Bewegungsvektors ein halbes Pixel; bei Codierungsoperationen (wie Bewegungsschätzung und DCT) zwischen "Rahmen" und "Feld" unterscheiden; Einführung von Codierungsskalierbarkeitstechnologien wie räumliche Skalierbarkeit, zeitliche Skalierbarkeit und Skalierbarkeit des Signal-Rausch-Verhältnisses. Der in den letzten Jahren eingeführte MPEG-4-Standard hat die Codierung auf der Basis von audiovisuellen Objekten (AVO: Audio-Visual Object) eingeführt, wodurch die interaktiven Funktionen und die Codierungseffizienz der Videokommunikation erheblich verbessert werden. MPEG-4 hat auch einige neue Technologien übernommen, wie z. B. Formcodierung, adaptive DCT, Codierung von Videoobjekten mit beliebiger Form und so weiter. Der grundlegende Video-Encoder von MPEG-263 gehört jedoch immer noch zu einer Art Hybrid-Encoder, der H.XNUMX ähnelt.

Kurz gesagt, die H.261-Empfehlung ist eine klassische Videokodierung, H.263 ist ihre Entwicklung und wird sie in der Praxis schrittweise ersetzen, hauptsächlich in der Kommunikation, aber die zahlreichen Optionen von H.263 machen Benutzer häufig ratlos. Die MPEG-Standardserie hat sich von Anwendungen für Speichermedien zu Anwendungen entwickelt, die sich an Übertragungsmedien anpassen. Das Grundgerüst der Kernvideokodierung stimmt mit H.261 überein. Unter diesen ist der auffällige Teil der "objektbasierten Codierung" von MPEG-4 darauf zurückzuführen, dass es immer noch technische Hindernisse gibt und es schwierig ist, sie universell anzuwenden. Daher überwindet der auf dieser Grundlage entwickelte neue Videokodierungsvorschlag H.264 die Schwächen der beiden, führt eine neue Codierungsmethode im Rahmen der Hybridcodierung ein, verbessert die Codierungseffizienz und steht vor praktischen Anwendungen. Gleichzeitig wurde es von den beiden großen internationalen Normungsorganisationen gemeinsam formuliert, und seine Anwendungsaussichten sollten selbstverständlich sein.

1. H.264 von JVT

H.264 ist ein neuer digitaler Videokodierungsstandard, der vom gemeinsamen Videoteam (JVT: Joint Video Team) der VCEG (Video Coding Experts Group) der ITU-T und der MPEG (Moving Picture Coding Experts Group) der ISO / IEC entwickelt wurde. Es ist Teil 10 von H.264 von ITU-T und MPEG-4 von ISO / IEC. Die Einholung von Entwürfen begann im Januar 1998. Der erste Entwurf wurde im September 1999 fertiggestellt. Das Testmodell TML-8 wurde im Mai 2001 entwickelt. Der FCD-Vorstand von H.264 wurde auf der 5. Sitzung der JVT im Juni 2002 verabschiedet. Der Standard befindet sich derzeit in der Entwicklung und wird voraussichtlich in der ersten Hälfte des nächsten Jahres offiziell verabschiedet.

H.264 ist wie der vorherige Standard auch ein Hybridcodierungsmodus von DPCM plus Transformationscodierung. Es verwendet jedoch ein prägnantes Design von "Return to Basics" ohne viele Optionen und erzielt eine viel bessere Komprimierungsleistung als H.263 ++. Es stärkt die Anpassungsfähigkeit an verschiedene Kanäle und nimmt eine "netzwerkfreundliche" Struktur und Syntax an. Förderlich für die Verarbeitung von Fehlern und Paketverlust; eine breite Palette von Anwendungszielen, um den Anforderungen unterschiedlicher Geschwindigkeiten, unterschiedlicher Auflösungen und unterschiedlicher Übertragungs- (Speicher-) Anlässe gerecht zu werden; Das Basissystem ist offen und für die Verwendung ist kein Urheberrecht erforderlich.

Technisch gesehen gibt es im H.264-Standard viele Highlights, wie z. B. einheitliche VLC-Symbolcodierung, hochpräzise Multi-Mode-Verschiebungsschätzung, ganzzahlige Transformation basierend auf 4 × 4-Blöcken und geschichtete Codierungssyntax. Diese Maßnahmen führen dazu, dass der H.264-Algorithmus eine sehr hohe Codierungseffizienz aufweist. Bei gleicher rekonstruierter Bildqualität können etwa 50% der Coderate als bei H.263 eingespart werden. Die Codestream-Struktur von H.264 weist eine starke Netzwerkanpassungsfähigkeit auf, erhöht die Fehlerbehebungsfunktionen und kann sich gut an die Anwendung von IP- und drahtlosen Netzwerken anpassen.

2. Technische Highlights von H264

Geschichtetes Design

Der H.264-Algorithmus kann konzeptionell in zwei Schichten unterteilt werden: Die Videocodierungsschicht (VCL: Video Coding Layer) ist für die effiziente Darstellung von Videoinhalten verantwortlich, und die Netzwerkabstraktionsschicht (NAL: Network Abstraction Layer) ist für den geeigneten Weg verantwortlich vom Netzwerk benötigt. Daten packen und übertragen. Die hierarchische Struktur des H.264-Codierers ist in Abbildung 1 dargestellt. Eine paketbasierte Schnittstelle ist zwischen VCL und NAL definiert, und das Packen und die entsprechende Signalisierung sind Teil von NAL. Auf diese Weise werden die Aufgaben einer hohen Codierungseffizienz und Netzwerkfreundlichkeit von VCL bzw. NAL erfüllt.

Die VCL-Schicht enthält eine blockbasierte Bewegungskompensations-Hybridcodierung und einige neue Funktionen. Wie die vorherigen Videokodierungsstandards enthält H.264 keine Funktionen wie Vorverarbeitung und Nachbearbeitung im Entwurf, was die Flexibilität des Standards erhöhen kann.

NAL ist dafür verantwortlich, das Segmentierungsformat des Netzwerks der unteren Schicht zum Einkapseln von Daten zu verwenden, einschließlich Framing, logischer Kanalsignalisierung, Verwendung von Zeitinformationen oder Sequenzendsignal usw. Beispielsweise unterstützt NAL Videoübertragungsformate auf leitungsvermittelten Kanälen und unterstützt Videoübertragungsformate im Internet über RTP / UDP / IP. NAL enthält seine eigenen Header-Informationen, Segmentstrukturinformationen und tatsächlichen Ladeinformationen, dh die VCL-Daten der oberen Schicht. (Wenn die Datensegmentierungstechnologie verwendet wird, können die Daten aus mehreren Teilen bestehen.)

Hochpräzise Multimode-Bewegungsschätzung

H.264 unterstützt Bewegungsvektoren mit einer Genauigkeit von 1/4 oder 1/8 Pixel. Bei einer Genauigkeit von 1/4 Pixel kann ein 6-Tap-Filter verwendet werden, um hochfrequentes Rauschen zu reduzieren. Für Bewegungsvektoren mit einer Genauigkeit von 1/8 Pixel kann ein komplexeres 8-Tap-Filter verwendet werden. Bei der Bewegungsschätzung kann der Codierer auch "erweiterte" Interpolationsfilter auswählen, um den Vorhersageeffekt zu verbessern

Bei der Bewegungsvorhersage von H.264 kann ein Makroblock (MB) gemäß Fig. 2 in verschiedene Unterblöcke unterteilt werden, um 7 verschiedene Modi von Blockgrößen zu bilden. Diese flexible und detaillierte Multimode-Unterteilung eignet sich besser für die Form der sich tatsächlich bewegenden Objekte im Bild und verbessert sich erheblich

Die Genauigkeit der Bewegungsschätzung wird verbessert. Auf diese Weise kann jeder Makroblock 1, 2, 4, 8 oder 16 Bewegungsvektoren enthalten.

In H.264 darf der Codierer mehr als einen vorherigen Frame für die Bewegungsschätzung verwenden, bei der es sich um die sogenannte Multi-Frame-Referenztechnologie handelt. Wenn beispielsweise 2 oder 3 Rahmen nur codierte Referenzrahmen sind, wählt der Codierer einen besseren Vorhersagerahmen für jeden Zielmakroblock aus und gibt für jeden Makroblock an, welcher Rahmen für die Vorhersage verwendet wird.

4 × 4-Block-Integer-Transformation

H.264 ähnelt dem vorherigen Standard und verwendet eine blockbasierte Transformationscodierung für den Rest, aber die Transformation ist eine Ganzzahloperation anstelle einer reellen Zahlenoperation, und der Prozess ähnelt im Wesentlichen dem von DCT. Der Vorteil dieses Verfahrens besteht darin, dass im Codierer und im Decodierer die gleiche Präzisionstransformation und inverse Transformation zulässig sind, was die Verwendung einer einfachen Festkomma-Arithmetik erleichtert. Mit anderen Worten, hier gibt es keinen "inversen Transformationsfehler". Die Transformationseinheit sind 4 × 4 Blöcke anstelle von 8 × 8 Blöcken, die üblicherweise in der Vergangenheit verwendet wurden. Wenn die Größe des Transformationsblocks verringert wird, ist die Aufteilung des sich bewegenden Objekts genauer. Auf diese Weise ist nicht nur der Transformationsberechnungsbetrag relativ klein, sondern auch der Konvergenzfehler am Rand des sich bewegenden Objekts wird stark reduziert. Damit das kleine Blocktransformationsverfahren nicht den Graustufendifferenz zwischen den Blöcken im größeren glatten Bereich des Bildes erzeugt, wird der Gleichstromkoeffizient von 16 4 × 4-Blöcken der Intra-Frame-Makroblock-Helligkeitsdaten (jeder kleine Block Eins) verwendet , insgesamt 16) führen eine zweite 4 × 4-Blocktransformation durch und führen eine 2 × 2-Blocktransformation für die Gleichstromkoeffizienten von 4 4 × 4-Blöcken von Chrominanzdaten durch (einer für jeden kleinen Block, insgesamt 4).

Um die Fähigkeit zur Ratenkontrolle von H.264 zu verbessern, wird die Änderung der Quantisierungsschrittgröße anstelle einer konstanten Zunahme auf etwa 12.5% gesteuert. Die Normalisierung der Amplitude des Transformationskoeffizienten wird im inversen Quantisierungsprozess verarbeitet, um die Rechenkomplexität zu verringern. Um die Farbtreue hervorzuheben, wird eine kleine Quantisierungsschrittgröße für den Chrominanzkoeffizienten verwendet.

Einheitlicher VLC

In H.264 gibt es zwei Methoden zur Entropiecodierung. Eine besteht darin, für alle zu codierenden Symbole eine einheitliche VLC (UVLC: Universal VLC) zu verwenden, und die andere darin, eine inhaltsadaptive binäre arithmetische Codierung (CABAC: Context-Adaptive) zu verwenden. Binäre arithmetische Codierung). CABAC ist eine optionale Option. Die Codierungsleistung ist etwas besser als bei UVLC, aber auch der Rechenaufwand ist höher. UVLC verwendet einen Codewortsatz mit unbegrenzter Länge, und die Entwurfsstruktur ist sehr regelmäßig, und verschiedene Objekte können mit derselben Codetabelle codiert werden. Diese Methode ist einfach, ein Codewort zu generieren, und der Decoder kann das Präfix des Codeworts leicht identifizieren, und UVLC kann schnell eine Resynchronisation erhalten, wenn ein Bitfehler auftritt

Hier sind x0, x1, x2, ... INFO-Bits und 0 oder 1. In Abbildung 4 sind die ersten 9 Codewörter aufgeführt. Zum Beispiel enthält das Wort mit der 4. Nummer INFO01. Das Design dieses Codeworts ist für eine schnelle Resynchronisation optimiert, um Bitfehler zu vermeiden.

Intra-Pdiction

In den früheren Standards der H.26x-Serie und der MPEG-x-Serie werden Inter-Frame-Vorhersagemethoden verwendet. In H.264 ist eine Intra-Frame-Vorhersage verfügbar, wenn Intra-Bilder codiert werden. Für jeden 4 × 4-Block (mit Ausnahme der speziellen Behandlung des Kantenblocks) kann jedes Pixel mit einer anderen gewichteten Summe der 17 nächstgelegenen zuvor codierten Pixel vorhergesagt werden (einige Gewichte können 0 sein), dh dieses Pixel 17 Pixel in der oberen linken Ecke des Blocks. Offensichtlich ist diese Art der Intra-Frame-Vorhersage nicht zeitlich, sondern ein im räumlichen Bereich durchgeführter prädiktiver Codierungsalgorithmus, der die räumliche Redundanz zwischen benachbarten Blöcken beseitigen und eine effektivere Komprimierung erzielen kann.

In dem 4 × 4-Quadrat sind a, b, ..., p 16 vorherzusagende Pixel, und A, B, ..., P sind codierte Pixel. Zum Beispiel kann der Wert von Punkt m durch die Formel (J + 2K + L + 2) / 4 oder durch die Formel (A + B + C + D + I + J + K + L) / 8 vorhergesagt werden. und so weiter. Entsprechend den ausgewählten Vorhersagereferenzpunkten gibt es 9 verschiedene Modi für die Luminanz, aber es gibt nur 1 Modus für die Intra-Frame-Vorhersage der Chrominanz.

Für IP- und drahtlose Umgebungen

Der H.264-Entwurf enthält Tools zur Fehlerbeseitigung, um die Übertragung von komprimiertem Video in einer Umgebung mit häufigen Fehlern und Paketverlusten zu erleichtern, z. B. die Robustheit der Übertragung in mobilen Kanälen oder IP-Kanälen.

Um Übertragungsfehlern zu widerstehen, kann die Zeitsynchronisation im H.264-Videostream unter Verwendung einer Bildaktualisierung innerhalb des Rahmens erreicht werden, und die räumliche Synchronisation wird durch eine Slice-strukturierte Codierung unterstützt. Gleichzeitig wird zur Erleichterung der Resynchronisation nach einem Bitfehler auch ein bestimmter Resynchronisationspunkt in den Videodaten eines Bildes bereitgestellt. Darüber hinaus ermöglichen die Aktualisierung von Makroblöcken innerhalb eines Rahmens und mehrere Referenzmakroblöcke dem Codierer, nicht nur die Codierungseffizienz, sondern auch die Eigenschaften des Übertragungskanals bei der Bestimmung des Makroblockmodus zu berücksichtigen.

Zusätzlich zur Verwendung der Änderung der Quantisierungsschrittgröße zur Anpassung an die Kanalcoderate wird in H.264 häufig das Verfahren der Datensegmentierung verwendet, um die Änderung der Kanalcoderate zu bewältigen. Im Allgemeinen besteht das Konzept der Datensegmentierung darin, Videodaten mit unterschiedlichen Prioritäten im Encoder zu generieren, um die QoS der Dienstqualität im Netzwerk zu unterstützen. Beispielsweise wird ein syntaxbasiertes Datenpartitionierungsverfahren angewendet, um die Daten jedes Rahmens entsprechend seiner Wichtigkeit in mehrere Teile zu unterteilen, wodurch die weniger wichtigen Informationen verworfen werden können, wenn der Puffer überläuft. Ein ähnliches zeitliches Datenpartitionierungsverfahren kann auch verwendet werden, was durch Verwendung mehrerer Referenzrahmen in P- und B-Rahmen erreicht wird.

Bei der Anwendung der drahtlosen Kommunikation können wir große Änderungen der Bitrate des drahtlosen Kanals unterstützen, indem wir die Quantisierungsgenauigkeit oder die Raum / Zeit-Auflösung jedes Rahmens ändern. Im Fall von Multicast ist es jedoch unmöglich, vom Codierer zu verlangen, auf unterschiedliche Bitraten zu reagieren. Daher verwendet H.4 im Gegensatz zur in MPEG-264 verwendeten FGS-Methode (Fine Granular Scalability) (mit geringerer Effizienz) anstelle einer hierarchischen Codierung Stream-Switching-SP-Frames.

========================

3. TML-8-Leistung

TML-8 ist der Testmodus von H.264. Verwenden Sie ihn, um die Videocodierungseffizienz von H.264 zu vergleichen und zu testen. Das durch die Testergebnisse bereitgestellte PSNR hat deutlich gezeigt, dass die Ergebnisse von H.4 im Vergleich zur Leistung von MPEG-263 (ASP: Advanced Simple Profile) und H.264 ++ (HLP: High Latency Profile) offensichtliche Vorteile haben. Wie in Abbildung 5 gezeigt.

Das PSNR von H.264 ist offensichtlich besser als das von MPEG-4 (ASP) und H.263 ++ (HLP). Im Vergleichstest mit 6 Geschwindigkeiten ist der PSNR von H.264 im Durchschnitt 2 dB höher als der von MPEG-4 (ASP). Es ist durchschnittlich 3 dB höher als H.263 (HLP). Die 6 Testraten und die damit verbundenen Bedingungen sind: 32 kbit / s Rate, 10 f / s Bildrate und QCIF-Format; 64 kbit / s Rate, 15f / s Bildrate und QCIF-Format; 128 kbit / s Rate, 15 f / s Bildrate und CIF-Format; 256 kbit / s Rate, 15 f / s Bildrate und QCIF-Format; 512 kbit / s Rate, 30f / s Bildrate und CIF-Format; 1024 kbit / s Rate, 30f / s Bildrate und CIF-Format.

4. Schwierigkeit der Realisierung

Für jeden Ingenieur, der praktische Anwendungen in Betracht zieht und gleichzeitig auf die überlegene Leistung von H.264 achtet, muss er die Schwierigkeit seiner Implementierung messen. Im Allgemeinen wird die Verbesserung der H.264-Leistung auf Kosten einer erhöhten Komplexität erzielt. Mit der Entwicklung der Technologie liegt diese Zunahme der Komplexität jedoch im akzeptablen Bereich unserer gegenwärtigen oder in naher Zukunft befindlichen Technologie. In Anbetracht der Einschränkung der Komplexität hat H.264 einige besonders rechenintensive verbesserte Algorithmen nicht übernommen. Beispielsweise verwendet H.264 keine globale Bewegungskompensationstechnologie, die in MPEG-4 ASP verwendet wird. Erhöhte erhebliche Codierungskomplexität.

Sowohl H.264 als auch MPEG-4 enthalten B-Frames und sind präziser und komplex-Bewegungsinterpolationsfilter als MPEG-2, H.263 oder MPEG-4 SP (Simple-Profil). Um die Bewegungsschätzung besser zu vervollständigen, hat H.264 die Typen der variablen Blockgrößen und die Anzahl der variablen Referenzbilder deutlich erhöht.

Die H.264-RAM-Anforderungen werden hauptsächlich für Referenzbildbilder verwendet, und die meisten codierten Videos verwenden 3 bis 5 Bilder von Referenzbildern. Es wird nicht mehr ROM als der übliche Video-Encoder benötigt, da H.264 UVLC für alle Datentypen eine gut strukturierte Nachschlagetabelle verwendet

5. abschließende Bemerkungen

H.264 bietet breite Anwendungsmöglichkeiten, wie Echtzeit-Videokommunikation, Internet-Videoübertragung, Video-Streaming-Dienste, Mehrpunktkommunikation in heterogenen Netzwerken, komprimierter Videospeicher, Videodatenbanken usw.

Die technischen Merkmale der H.264-Empfehlungen lassen sich in drei Aspekte zusammenfassen. Eine besteht darin, sich auf die Praktikabilität zu konzentrieren, ausgereifte Technologien zu übernehmen, eine höhere Codierungseffizienz anzustreben und einen präzisen Ausdruck zu erzielen. Die andere besteht darin, sich auf die Anpassung an Mobil- und IP-Netzwerke zu konzentrieren und eine hierarchische Technologie anzuwenden, die die Codierung und den Kanal formal trennt und im Wesentlichen die Eigenschaften des Kanals im Quellcodierungsalgorithmus stärker berücksichtigt. Das dritte ist, dass unter dem Grundgerüst des Hybrid-Encoders alle seine Hauptkomponenten hergestellt werden. Wichtige Verbesserungen wie Multi-Mode-Bewegungsschätzung, Intra-Frame-Vorhersage, Multi-Frame-Vorhersage, einheitlicher VLC, zweidimensionale 4 × 4-Ganzzahltransformation usw.

Bisher wurde H.264 noch nicht fertiggestellt, aber aufgrund seines höheren Komprimierungsverhältnisses und seiner besseren Kanalanpassungsfähigkeit wird es im Bereich der digitalen Videokommunikation oder -speicherung immer häufiger eingesetzt und sein Entwicklungspotenzial ist unbegrenzt.

Schließlich muss angemerkt werden, dass die überlegene Leistung von H.264 nicht ohne Kosten ist, aber die Kosten sind eine große Zunahme der Rechenkomplexität. Schätzungen zufolge beträgt die rechnerische Komplexität der Codierung ungefähr das Dreifache von H.263 und die Komplexität der Decodierung ungefähr das Zweifache von H.2.

===========================

Verstehen Sie die Produkte der H.264- und MPEG-4-Technologie richtig und beseitigen Sie die falsche Propaganda des Herstellers

Es ist bekannt, dass der H.264-Video-Codec-Standard einen gewissen Fortschritt aufweist, jedoch nicht der bevorzugte Video-Encoder-Standard ist, insbesondere als Überwachungsprodukt, da er auch einige technische Mängel aufweist.

ist im MPEG-4 Part 10-Standard als H.264-Videocodec-Standard enthalten, dh er ist nur an den zehnten Teil von MPEG-4 angeschlossen. Mit anderen Worten, H.264 überschreitet nicht den Geltungsbereich des MPEG-4-Standards. Daher ist es falsch, dass der H.264-Standard und die Videoübertragungsqualität im Internet höher sind als bei MPEG-4. Der Übergang von MPEG-4 zu H.264 ist noch unverständlicher. Lassen Sie uns zunächst die Entwicklung von MPEG-4 richtig verstehen:

1. MPEG-4 (SP) und MPEG-4 (ASP) sind die frühen Produkttechnologien von MPEG-4

MPEG-4 (SP) und MPEG-4 (ASP) wurden 1998 vorgeschlagen. Die Technologie hat sich bis heute entwickelt, und es gibt tatsächlich einige Probleme. Daher hat das derzeitige staatliche technische Personal, das MPEG-4 entwickeln kann, diese Rückwärtstechnologie nicht in MPEG-4-Videoüberwachungs- oder Videokonferenzprodukten übernommen. Der Vergleich zwischen H.264-Produkten (technische Produkte nach 2005) und der im Internet beworbenen frühen MPEG-4 (SP) -Technologie ist wirklich unangemessen. Kann der Leistungsvergleich von IT-Produkten in den Jahren 2005 und 2001 überzeugen? . Hier muss erklärt werden, dass dies ein technisches Hype-Verhalten der Hersteller ist.

Bitte schauen Sie sich den Technologievergleich an:

Einige Hersteller haben Vergleiche fehlgeleitet: Bei gleicher rekonstruierter Bildqualität reduziert H.264 die Bitrate um 50% im Vergleich zu H.263 + und MPEG-4 (SP).

Diese Daten vergleichen im Wesentlichen die Produktdaten der neuen H.264-Technologie mit den Produktdaten der frühen MPEG-4-Technologie, was für den Vergleich der aktuellen MPEG-4-Technologieprodukte bedeutungslos und irreführend ist. Warum haben H.264-Produkte 4 keine Daten mit neuen MPEG-2006-Technologieprodukten verglichen? Die Entwicklung der H.264-Videokodierungstechnologie ist zwar sehr schnell, aber der Videodekodierungseffekt entspricht nur dem Videoeffekt von Microsoft Windows Media Player 9.0 (WM9). Gegenwärtig hat beispielsweise die MPEG-4-Technologie, die von Huayis Festplattenvideoserver und Videokonferenzgeräten verwendet wird, die technischen Spezifikationen (WMV) für die Videodecodierungstechnologie erreicht, und die Audio- und Videosynchronisation beträgt weniger als 0.15 Sekunden (innerhalb von 150 Millisekunden) ). H.264 und Microsoft WM9 können nicht übereinstimmen

2. Die sich entwickelnde MPEG-4-Videodecodertechnologie:

Derzeit entwickelt sich die MPEG-4-Videodecodertechnologie rasant, nicht wie der Hype der Hersteller im Internet. Der Vorteil des aktuellen H.264-Bildstandards liegt nur in seiner Komprimierung und Speicherung, die 15 bis 20% kleiner ist als die aktuelle MPEG-4-Speicherdatei von Huayi-Produkten, aber sein Videoformat ist kein Standardformat. Der Grund dafür ist, dass H.264 kein international verwendetes Speicherformat verwendet und seine Videodateien nicht mit international verwendeter Software von Drittanbietern geöffnet werden können. In einigen nationalen Regierungen und Behörden wird daher bei der Auswahl der Geräte eindeutig angegeben, dass die Videodateien mit international anerkannter Software von Drittanbietern geöffnet werden müssen. Dies ist sehr wichtig für die Überwachung von Produkten. Insbesondere bei Diebstahl muss die Polizei Beweise einholen, analysieren usw.

Die aktualisierte Version des MPEG-4-Videodecoders ist (WMV), und das Audio ist je nach Codierungstechnologie und Erfahrung jedes Herstellers unterschiedlich. Die derzeit ausgereiften MPEG-4-Produkte mit neuer Technologie von 2005 bis 2006 sind in Bezug auf die Leistung weitaus höher als die Produkte mit H.264-Technologie.

In Sachen Übertragung: Im Vergleich zum neuen MPEG-4-Technologieprodukt H.264, es liegen folgende Mängel vor:

1. Audio- und Videosynchronisation: Die H.264-Audio- und Videosynchronisation weist einige Probleme auf, hauptsächlich in Bezug auf die Verzögerung. Die Übertragungsleistung von H.264 entspricht der von Microsoft Windows Media Player 9.0 (WM9). Gegenwärtig erreicht die vom Huayi-Netzwerkvideoserver verwendete MPEG-4-Technologie im Bereich der Videoüberwachung und Videokonferenzen eine Verzögerung von weniger als 0.15 Sekunden (150 Millisekunden), was für H.264-Produkte unerreichbar ist.

2. Effizienz der Netzwerkübertragung: H.2 übernehmen

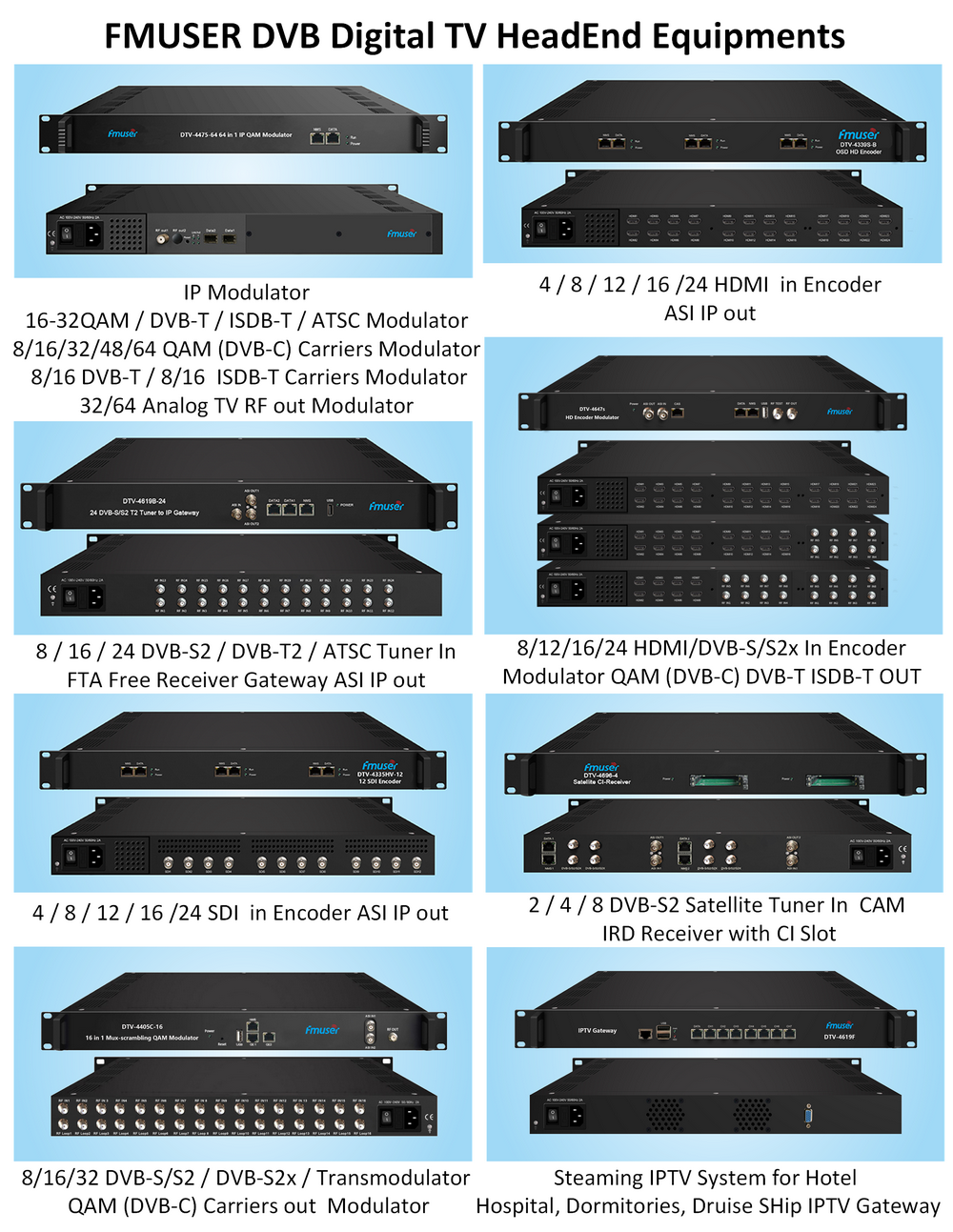

Unsere anderen Produkt: